用多模态大模型做视频理解:从可能到可靠的距离

当我们尝试让 AI “看懂”一支广告视频时,发现问题远比”调一个 API”复杂得多。

为什么要用大模型来分析视频?

在广告行业里,有一个长期未被解决的问题:创意与效果之间的因果关系几乎是个黑箱。

我们知道一支广告花了多少钱、带来了多少转化,但很难回答”为什么这支广告比那支好”。是开头的钩子更吸引人?还是 CTA 的措辞恰好击中了用户?传统方法依赖人工标注,成本高、主观性强、难以规模化。

多模态大模型的出现,第一次让我们看到了自动化、结构化地理解视频创意的可能。

但”可能”和”可靠”之间,还有很长的路。

模型的能力边界

以当前最新的多模态模型为例,它们已经可以直接接收视频文件、理解时序叙事、做跨模态推理(画面 + 文字 + 声音),甚至按照结构化 schema 输出 JSON。这些能力放在两年前不可想象。

但在实际工程中,我们发现了几个根本性的张力:

精确性与语义性的矛盾。 模型擅长语义——它能告诉你”视频中段有产品特写”,但很难精确到具体的时间区间。它对时间的感知是叙述性的,不是帧级精确的。这意味着你不能让模型同时承担”分割”和”理解”两个角色。

全局与细节的权衡。 当你把一个 30 秒视频和几十个分析字段一起扔给模型,它会”抓大放小”——视频级别的判断不错,但具体到每个镜头里的细节,准确率就开始下降。一次性要求太多,模型的注意力会分散。

概率输出与确定性需求的冲突。 大模型本质是概率性的。即使 temperature 设为 0,同一视频两次分析的结果在某些字段上可能不一致。它不真正”理解”你的 schema 约束——它只是在做概率上的最佳猜测。它会自信地给出错误答案,也不一定在不确定时说”我不知道”。

这些不是 bug,是大模型这种技术范式的内在特征。你可以等模型更强来缩小差距,但不能指望这些张力完全消失。

工程设计比模型选择更重要

认清这些边界之后,真正的问题变成了:如何在一个概率性的、会犯错的能力之上,构建一个需要确定性和一致性的系统?

我们逐渐形成了几个设计原则:

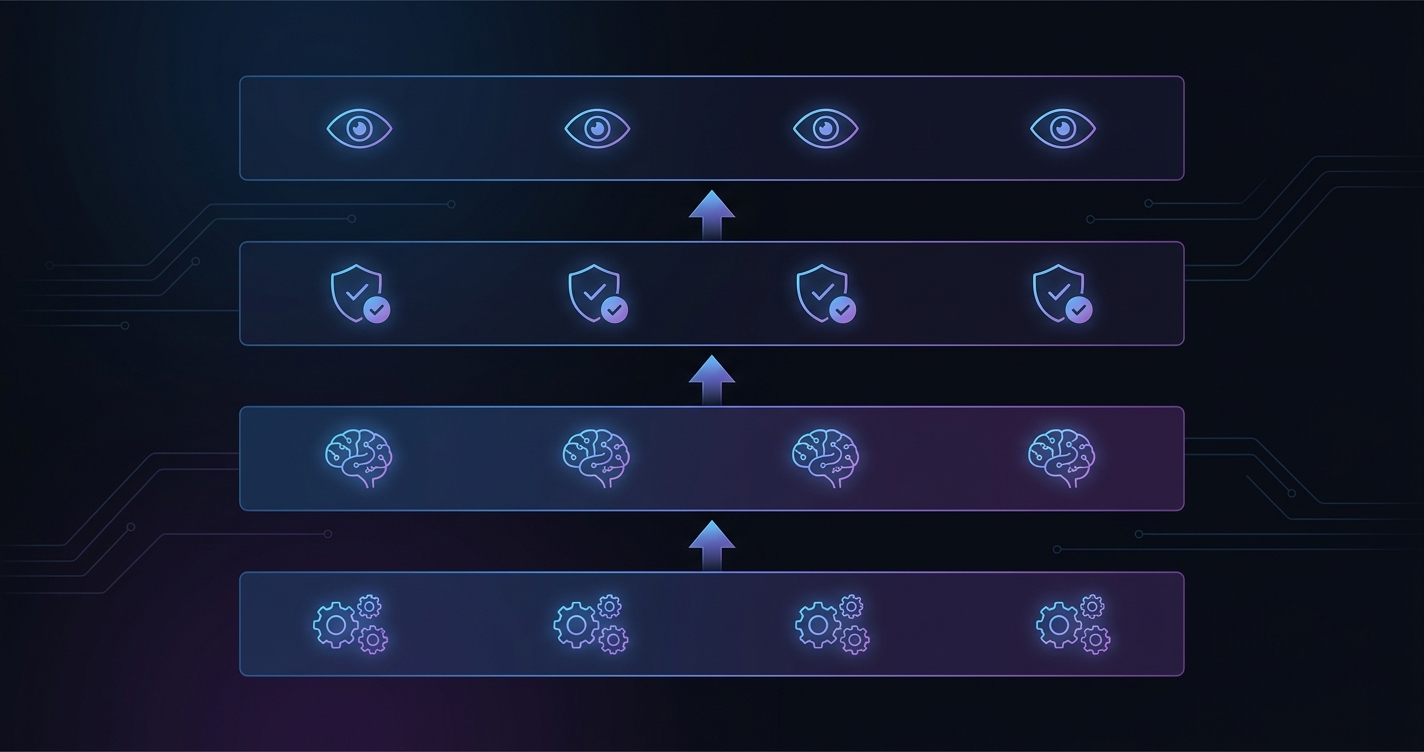

让每一层做自己擅长的事。 传统算法做精确分割,大模型做语义理解,规则引擎做约束验证,人类做语义定义和质量标准设定。每层在自己的能力范围内工作,通过清晰的接口组合起来。这比指望一个万能模型端到端解决所有问题要务实得多。

分治优于一次性。 与其把全部信息一次性塞给模型,不如先全局后局部——第一遍做整体判断和规划,第二遍针对每个局部做细节提取。每一步有独立的职责边界和约束。这种分治策略显著提高了细节准确性。

Schema 是产品合约,不是配置文件。 如果你的分析结果要被下游消费(做建模、做报表、做决策),schema 的稳定性和一致性就是核心竞争力。每次 schema 变更都需要同步更新 prompt 指导和验证规则——这三者是一个整体,只改其中一个,系统就会出现不一致。

Prompt 是代码,不是注释。 在我们的系统里,prompt 的行数超过了很多核心模块。它不是”给模型的一段说明”,而是系统行为规范的一部分——定义了模型应该怎么思考、怎么区分相似概念、怎么处理不确定性。如果你把 prompt 当成可以随便改的配置文件,系统输出质量会迅速退化。Prompt 应该被版本控制、被 review、被当作一等公民。

对”理解”本身的思考

当我们说模型”理解了”一段视频,我们到底在说什么?

模型能识别出”一个人在对着镜头说话”,但不一定能可靠判断这个人的表演风格是 UGC 感还是品牌感。它能看到画面上有文字,但”这段文字是免责声明还是用户评价”的判断有时会出错。

多模态模型目前提供的是一种中等粒度的语义理解——比关键词匹配深,比人类专家浅。认清这一点很重要,因为它决定了你应该怎么设计系统:不要指望模型做所有事,而是把它放在一个有约束、有验证、有兜底的框架里。

你需要重新思考”正确性”的定义——对关键字段设严格约束,对模糊字段允许合理波动,用后置验证而非前置假设来保证质量。这不是妥协,而是对问题本质的尊重。

写在最后

多模态大模型让很多之前不可能的事情变成了可能,但”可能”和”可靠”之间还有很长的路。

在这条路上,工程设计的价值不会因为模型能力的提升而消失——恰恰相反,模型越强大,围绕它的工程架构就越关键。因为你需要把一个概率性的、会犯错的、不完全可控的能力,嵌入到一个需要确定性、一致性和可追溯性的业务系统里。

这可能是当下 AI 工程最有趣的挑战之一。